Top 12 professionelle Tipps, um Audio-Mixe lauter zu machen

Während viele von uns die Deeskalation des sogenannten „Loudness War“ bejubeln, ist es für Musiker und Musikfans immer noch üblich, laute Mixe zu bevorzugen. Während Streaming-Dienste daran arbeiten, die Lautstärke aller Songs anzupassen, ist die Loudness-Bias außerhalb des Streamings immer noch lebendig. Für viele Mixer ist es also unsere Aufgabe, unsere Mixe laut klingen zu lassen (zumindest laut genug, um mit anderen kommerziell erfolgreichen Songs Schritt zu halten), ohne den Mix vollständig zu zerstören.

Hier sind die Top 12 Profi-Tipps, um Ihre Mixe lauter zu machen:

- Produktion/Arrangement

- Hochpassfilterung

- EQ-Boosting im mittleren Bereich

- Chirurgischer EQ

- Verzerrung & Sättigung

- Serielle Komprimierung

- Parallele Komprimierung

- Multiband-Komprimierung

- Automatisierung

- Hall

- Verwenden Sie Limiter

- Experimentieren Sie vorsichtig mit Clipping

Lassen Sie uns in jeden dieser Tipps genauer eintauchen und herausfinden, wie Sie Ihre Mischungen lauter machen können. In diesem Artikel werden wir auch die Idee der Lautstärke, die Nachteile der Suche nach Lautstärke und den Lautheitskrieg im Allgemeinen diskutieren.

Beachten Sie, dass, während viele dieser Strategien beim Mischen nützlich sind, einige wahrscheinlich am besten für das Mastering gespeichert werden, insbesondere die Tipps 11 und 12.

Spitzenpegel, Headroom & wahrgenommene Lautstärke

Bevor wir in unsere Diskussion über die Erhöhung der Lautstärke unserer Mischungen einsteigen, sollten wir versuchen zu verstehen, was Lautheit eigentlich ist und welche Terminologie sie umgibt.

Spitzen- und RMS-Werte

Lassen Sie uns zunächst die Spitzen- und RMS-Werte besprechen.

Der Spitzenpegel eines Audiosignals bezieht sich auf die momentane Messung des Pegels des Audiosignals. In der Praxis beschäftigen wir uns hauptsächlich mit den höchsten Spitzen eines Audiosignals im Laufe der Zeit, die tendenziell auf den Transienten auftreten.

Der quadratische Mittelwert (RMS) eines Audiosignals ist die Quadratwurzel des mittleren Quadrats eines Audiosignals über ein festgelegtes Zeitfenster. Da Audiosignale oft maximale positive und negative Spitzen aufweisen, wird RMS verwendet, um einen „durchschnittlichen“ Signalpegel anzugeben.

Kopffreiheit

Als nächstes verstehen wir den Headroom.

Headroom ist technisch gesehen der verfügbare Pegel über dem Nennpegel eines Audiosystems und seinem maximalen Pegel. Diese Definition ist der Schlüssel zum Verständnis bei der Arbeit mit analogem Audio und Geräten, bei denen die Messung möglicherweise nicht bis zum maximalen Pegel verfügbar ist.

Im digitalen Audio, wo wir eine definierte harte Decke bei 0 dBFS haben, verstehen wir Headroom als den verfügbaren Raum zwischen den Spitzenpegeln eines Signals und der 0 dBFS-Decke.

Der Versuch, die Audiosignalpegel über die maximalen Signalverarbeitungsfähigkeiten eines Systems hinaus zu erhöhen, führt zu Verzerrungen aufgrund der Abflachung der Ober- und/oder Unterseite der Audiowellenform. Diese Abflachung der Wellenform wird als „Clipping“ bezeichnet.

Analoges Clipping kommt tendenziell etwas langsamer und klingt etwas musikalischer. Die Verzerrungseigenschaften variieren von einem analogen Gerät zum anderen. Digitales Clipping ist abrupter und rauer und in der Regel unerwünscht.

Kurz gesagt, es ist ratsam, vor dem Mastering etwas Kopffreiheit im Mix zu lassen. Die Praxis des Masterings und der Erhöhung der Pegel wird diesen Spielraum gegen zusätzliche Lautstärke eintauschen.

Wahrgenommene Lautstärke

Kommen wir zur wahrgenommenen Lautstärke.

Auf der grundlegendsten Ebene klingt ein stärkeres Audiosignal (eines mit einem höheren Effektivwert), das über dasselbe System wiedergegeben wird, lauter als ein schwächeres Audiosignal. Das ist jedoch nicht die ganze Geschichte.

Die wahrgenommene Lautstärke ist ein komplexer psychoakustischer Faktor. Jedes Mal, wenn wir über Wahrnehmung diskutieren, kommen wir in die Subjektivität und die Physiologie des auditorischen Systems einer Person.

Davon abgesehen gibt es Standards und akzeptierte Normen, wenn es darum geht, was „Lautstärke“ ausmacht.

Zunächst ist zu beachten, dass das menschliche Gehör einen allgemein akzeptierten Frequenzgang von 20 Hz – 20.000 Hz hat und dass wir in diesem Bereich nicht alle Frequenzen gleichermaßen hören.

Wir sind von Natur aus empfindlicher für die mittleren Frequenzen als für die unteren und oberen Enden des hörbaren Bereichs. Das bedeutet, dass der Schalldruckpegel bei den tiefen und oberen Frequenzen relativ höher sein muss als bei den mittleren Frequenzen, damit wir sie bei gleicher Lautstärke wahrnehmen können.

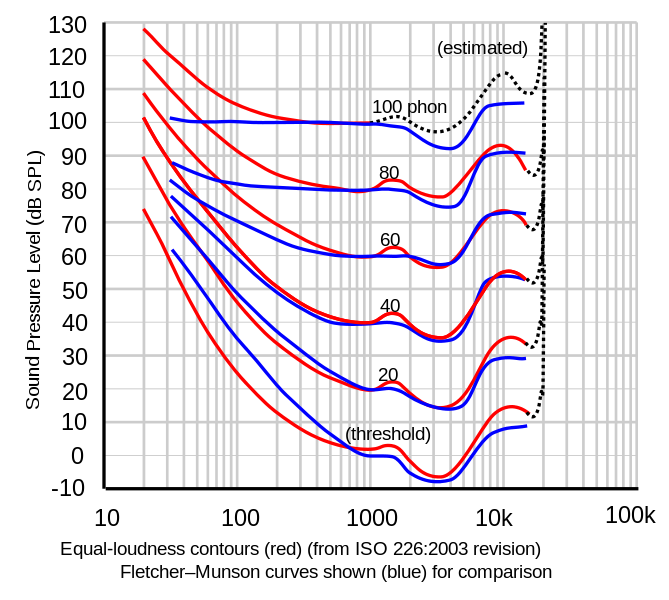

Unsere Hörempfindlichkeit über das hörbare Spektrum oder unseren natürlichen „Frequenzgang“ wurde untersucht, und es wurden Diagramme erstellt, um zu zeigen, wie wir bestimmte Frequenzen relativ zu anderen hören, wobei der Schalldruckpegel oder die „Lautstärke“ berücksichtigt werden.

Die Fletcher-Munson-Kurven wurden 1933 veröffentlicht, um dies zu zeigen, während der neuere gleiche Lautstärkepegel Contours wurden 1955 veröffentlicht. Beide zeigen, wie unterschiedlich wir Frequenzen hören. Werfen wir einen Blick darauf:

Die Linien stellen phon dar, eine logarithmische Einheit des Lautstärkepegels für Töne und komplexe Klänge. Wie Sie sehen, reagieren wir am empfindlichsten auf Schall im Bereich von 2 – 6 kHz. Beachten Sie auch, dass die Reaktion mit steigendem Schalldruckpegel flacher wird.

Wenn wir dieses psychoakustische Merkmal auf Audio ausdehnen, können wir verstehen, wie wir eine größere Signalpegeldarstellung im unteren und oberen Ende benötigen, um diese Frequenzbereiche zu hören, sobald das Audio richtig in Klang umgewandelt wurde.

Als zusätzlichen Punkt können viele Lautsprecher das sehr niedrige und obere Ende des hörbaren Bereichs ohnehin nicht genau wiedergeben, aber ich schweife ab.

Während der oben erwähnte RMS-Pegel uns eine Vorstellung von den durchschnittlichen Audiopegeln gibt und wie laut es im Vergleich zu anderen Audiogeräten im selben System sein wird, berücksichtigt er nicht die Variationen in unserer natürlichen Hörreaktion.

Der beste Weg, die Lautstärke zu beurteilen, ist das Zuhören. Wir haben jedoch auch LUFS (Loudness Units Full Scale), das Loudness-Einheiten verwendet, um die Lautstärke eines Signals oder Mixes relativ zum vollen Skalenendwert (0 dBFS) zu verstehen. Beachten Sie, dass es sich um ein digitales Messsystem handelt.

Loudness-Einheiten berücksichtigen die menschliche Wahrnehmung und die elektrische Signalintensität in einer standardisierten Messung. Zwei Mixe, die sich auf dem gleichen LUFS befinden, sollten theoretisch als genau die gleiche Lautstärke wahrgenommen werden.

LUFS wird im Allgemeinen über festgelegte Zeitfenster gemessen, einschließlich:

- Integriertes LUFS: über den gesamten Mix

- Kurzzeit-LUFS: über die letzten 3 Sekunden des Audios

- Momentane LUFS: über die letzten 400 Millisekunden Audio

Rekapitulation

Um unsere Mixe laut zu machen, müssen wir den in unserem System verfügbaren Spielraum nutzen und den Durchschnittspegel erhöhen, ohne dass die Spitzen die maximale Obergrenze überschreiten. Darüber hinaus hören wir nicht alle Frequenzen gleich, und bestimmte Frequenzbänder verbrauchen mehr Headroom als andere (dies ist insbesondere bei den Low-End-Subbassfrequenzen der Fall).

Die Erhöhung der wahrgenommenen Lautstärke eines Mixes hat seinen Preis

Sobald wir die Obergrenze der maximalen Signalverarbeitungsfähigkeiten unseres Systems erreicht haben (0 dBFS in digitalen Systemen), bedeutet jede Erhöhung der wahrgenommenen Lautstärke eines Mixes, dass der Durchschnittspegel angehoben wird, ohne die Spitzen zu erhöhen.

Mit anderen Worten, abgesehen davon, dass wir den Mix hochdrehen, bis die höchste Spitze die Decke erreicht hat und nicht höher, müssen wir die Wellenform des Audios des Mixes formen. Dies hat Nebenwirkungen auf die Mischung.

Das Ziel der Loudness-Verarbeitung, anders ausgedrückt, ist es, die wahrgenommene Lautstärke auf ein angemessenes Niveau zu erhöhen, ohne die Qualitäten zu beeinträchtigen, die den Mix von Anfang an großartig gemacht haben.

Beim Vorantreiben von „Loudness War“ -Pegeln war es oft der Fall, dass die Mix-Qualität gelitten hat, um die Platte lauter klingen zu lassen.

Das Erhöhen der wahrgenommenen Lautstärke eines Mixes oder Masters hat tendenziell die Nebenwirkungen von vermindertem Dynamikumfang, Verzerrung, mangelnder Klarheit, Pumpen, Artefakten und anderen.

Ihre Mixe um der Lautstärke willen laut zu machen, ist nicht unbedingt die beste Methode, obwohl es immer noch üblich ist.

Streaming-Dienste haben weitgehend Loudness-Standards übernommen, die das gesamte Material auf einen festgelegten integrierten LUFS-Wert normalisieren. Dies bedeutet, dass leise Mischungen und laute Mischungen automatisch an den gleichen wahrgenommenen Lautheitspegel angepasst werden. Laute Songs werden „heruntergedreht“ und leise Songs werden „aufgedreht“, so dass es keine massiven Unterschiede zwischen verschiedenen Titeln in einer Wiedergabeliste gibt.

Darüber hinaus gibt es zunehmend Beschwerden über zu laute Mischungen, insbesondere wenn die Normalisierung die Lautstärkeverzerrung beseitigt. Laute Mixe sind ermüdend auf den Ohren und können keine Definition haben, was zu weniger Gesamtgenuss der Zuhörer führt.

Auf der anderen Seite ist nach so vielen Jahren zunehmender Lautstärke der „Klang“ von lauten Mischungen erwartet worden, so dass laute Mischungen oft das Ziel unserer Projekte sind.

Natürlich gibt es kreative Möglichkeiten, einen Mix auf einigermaßen laute Pegel zu bringen, ohne die Qualität des Mixes zu zerstören. Kommen wir jetzt zu ihnen!

Loudness Tipp 1: Produktion/Arrangement

Der erste Profi-Tipp für lautere Mixe kommt vor dem Mischen in der Arrangement- und Schreibphase.

Im Allgemeinen sind spärlichere Mischungen leichter laut zu bekommen, da weniger Elemente um ihre Position im Frequenz- und Stereospektrum konkurrieren. Anders ausgedrückt; Dichtere Mischungen sind in der Regel schwieriger laut zu bekommen und gleichzeitig sicherzustellen, dass jedes Element perfekt ausbalanciert ist.

Um einen möglichst lauten Mix mit möglichst wenigen negativen Nebenwirkungen zu erhalten, würden wireoretically das gesamte Frequenzspektrum zusammen mit dem gesamten Stereospektrum füllen wollen.

Wenn mehrere Instrumente um die gleichen Frequenzbereiche und Stereopositionen konkurrieren, müssen wir sie verarbeiten (oft mit EQ, Kompression und Sättigung), damit sie in den Mix passen und ausreichend hörbar sind.

Von den zuvor erwähnten Prozessen können EQ-Schnitte bestimmte Spuren ausdünnen und schwächer klingen lassen, Kompression kann das Leben bestimmter Spuren aussaugen und Sättigung kann bestimmte Spuren übermäßig verzerren.

Darüber hinaus ist die Phasenunterdrückung immer ein Problem, wenn bestimmte Frequenzen aufgrund der Phasenbeziehungen zwischen all den verschiedenen Spuren im Mix über- oder unterrepräsentiert sein können. Dies ist besonders besorgniserregend für die Lautstärke, wenn der Stereo-Mix zu Mono summiert wird.

Um diese Probleme zu bekämpfen, kann es vorteilhaft sein, die Anordnung und Produktion zu durchdenken und Instrumente mit verschiedenen Schlüsselfrequenzbändern zu wählen (wo sich der Großteil des harmonischen Inhalts befindet). Auf diese Weise hat jedes Instrument natürlich seinen eigenen „Slot“ im Mix und kann sauberer und lauter gemischt werden, was zu einem insgesamt saubereren und lauteren Mix führt.

Außerdem, wenn ich ein bisschen philosophisch mit Ihnen werden kann, könnten wir an Lautstärke im Sinne der Relativität denken. Was ist die langfristige Dynamik des Mixes? Ist der Song so arrangiert, dass es große, klimaktische, laute Teile und kleinere, aufbauende, „ruhige“ Teile gibt?

Ein Mangel an langfristiger Dynamik, bei der die „Lautstärke“ während des gesamten Songs statisch ist, mag einigen Produktionen gut passen. Die Gesamtheit eines Mixes um der Lautstärke willen laut zu machen, ist jedoch nicht unbedingt eine gute Strategie.

Zunächst einmal haben die Zuhörer in der Regel die Kontrolle über den Lautstärkeregler, so dass sie letztendlich steuern, wie laut die Wiedergabe sein wird. Zweitens gibt es wirklich nichts, worauf man „laut“ und „leise“ stützen kann, ohne eine bemerkenswerte langfristige Dynamik. Wenn zum Beispiel der letzte, gipfelnde Refrain genauso laut ist wie das Intro und der Breakdown, ist er dann wirklich klimaktisch, auch wenn das LUFS-Metrum hoch anzeigt?

Das Arrangieren und Produzieren von Songs mit einer guten Langzeitdynamik ist der Schlüssel, um die wahrgenommene Lautstärke in den Abschnitten der Songs zu erreichen, die groß sein müssen. Ja, das Senken der Pegel in den „ruhigeren Abschnitten“ kann das integrierte LUFS des Songs als Ganzes verringern. In Bezug auf Lautstärke und Dynamik ist es jedoch fast immer eine gute Sache.

Loudness-Tipp 2: Hochpassfilterung

Die Hochpassfilterung ist der wichtigste EQ-Move, den Sie in einem bestimmten Mix machen werden.

Zuvor haben wir den hörbaren Bereich des menschlichen Gehörs und den „natürlichen Frequenzgang“ des typischen menschlichen Hörsystems diskutiert. Wir verstehen, dass Low-End-Frequenzen viel Energie erfordern, um gehört zu werden, und viel Spielraum im Mix verschlingen können.

Außerdem ist das untere Ende des Frequenzspektrums ohnehin nicht übermäßig musikalisch. Zum Beispiel beträgt die Grundfrequenz der E-Saite einer Bassgitarre 41 Hz, und die B-Saite eines 5-saitigen Basses wäre 31 Hz. Der wahre Klang der Bassgitarre (und anderer Instrumente) kommt jedoch von ihren Obertönen (insbesondere den ersten wenigen), die ganzzahlige Vielfache des Grundes sind.

Die meisten Instrumente haben also nicht viel, wenn überhaupt, im unteren Ende des Frequenzspektrums. Selbst Bassinstrumente haben nicht unbedingt einen signifikanten Frequenzgehalt im Low-End.

Ein weiterer Faktor, der in Bezug auf die lange Wellenlänge niedriger Frequenzen zu berücksichtigen ist, ist, dass sie anfälliger für Phasenauslöschung sind. Längere Wellenlängen schließen ihre Zyklen über längere Zeiträume ab. Wenn es also zu einer Phasenkompensation kommt, wirkt es sich auf eine längere Periode der Wellenform aus, was zu einer Verringerung der Gesamtstärke der Low-End-Frequenzen führt.

Wenn zwei Signale perfekt in Phase sind, gibt es eine Verdoppelung der Amplitude (+6 dB). Im Gegenteil, wenn zwei Signale vollkommen phasenverschoben sind, heben sie sich gegenseitig vollständig auf. Um die richtige Lautstärke und Klarheit im Low-End zu gewährleisten, müssen wir eine gute Phasenkohäsion haben, bei der alle Spuren mit Low-End phasenweise zusammenarbeiten, anstatt sich gegenseitig aufzuheben.

Das soll nicht heißen, dass sich hohe Frequenzen nicht auch durch Phasenunterdrückung gegenseitig aufheben. Ihre Zyklen passieren jedoch so schnell, dass die Phasenbeziehungen zwischen verschiedenen Spuren in den Mitten und Höhen weniger folgenreich sind.

Diese höherfrequenten Phasenwechselwirkungen sind auch viel schwieriger zu bekämpfen, obwohl wir eine bedeutende und durchdachte Rolle bei der Verbesserung der Phasenbeziehungen zwischen verschiedenen Spuren im unteren Bereich spielen können.

Betrachten wir diese drei Punkte zu niedrigen Frequenzen:

- Low-End-Frequenzen erfordern viel Energie, um gehört zu werden.

- Low-End-Frequenzen enthalten bei den meisten Instrumenten keine musikalischen Informationen.

- Low-End-Frequenzen sind anfälliger für Phasenprobleme.

Wenn wir diese drei Wahrheiten über Low-End-Frequenzen verstehen, können wir verstehen, wie die Hochpassfilterung der meisten unserer Spuren dazu beitragen kann, die Lautstärke zu verbessern.

Erstens reduziert es die Menge an Energie in den Low-End-Frequenzen, wodurch weniger Headroom verbraucht wird und wir die Möglichkeit haben, die Dinge lauter zu machen.

Zweitens eliminiert es unmusikalische Informationen wie Low-End-Rumpeln, mechanisches Rauschen, elektromagnetische Störungen und mehr. Wenn diese Informationen verschwunden sind, können wir die Pegel im Mix erhöhen, ohne das Low-End-Rumble zu verursachen.

Drittens reduziert die Eliminierung des unteren Endes der meisten Spuren das Potenzial für Phasenauslöschung, was uns mehr Kontrolle über die Solidarität der niederfrequenten Phasenkohäsion ermöglicht. Es ist wichtig zu beachten, dass Hochpassfilter und EQ im Allgemeinen die Phase eines Signals bei und um die Eckfrequenz verschieben. Je größer die Steigung des HPF ist, desto größer ist die Phasenverschiebung.

Ich habe ein Video, das den Nebeneffekt des EQ der Phasenverschiebung beschreibt. Sie können Schaut es euch hier an.

Es ist auch erwähnenswert, dass viele Instrumente Hochpassfilter über ihren Grundlagen sein können, wenn dies der Gesamtbalance des Mixes zugute kommt. Psychoakustisch wird das menschliche Gehirn die Grundlagen eines Klangs basierend auf den Obertönen effektiv ausfüllen, auch wenn sie nicht im Klang oder Mix vorhanden sind.

Manchmal führt eine Hochpassfilterung bei einer höheren Frequenz, als sie im Solo natürlich klingen würde, dazu, dass eine Spur besser in den Mix passt und Platz für wichtigere Spuren mit niedrigerer Frequenz in ihren jeweiligen Frequenzbändern macht.

Alles in allem sind Hochpassfilter der Schlüssel für die Lautstärke und das Mischen im Allgemeinen.

Loudness-Tipp 3: EQ-Verstärkung im mittleren Bereich

Wenn wir die wahrgenommene Lautstärke betrachten, müssen wir uns auf die oben erwähnte menschliche auditive Reaktion beziehen. Wenn wir uns die Fletcher-Munson-Kurven und Konturen der gleichen Lautstärke ansehen, können wir deutlich sehen, dass Menschen am empfindlichsten auf mittlere Frequenzen reagieren.

Im Vergleich zu den Low-End-Frequenzen, die wir im vorherigen Tipp angesprochen haben, verbrauchen mittlere Frequenzen nicht so viel Energie für Audiosignale und Klangwiedergabe.

Wir haben also die Situation, in der wir empfindlicher auf mittlere Frequenzen reagieren, die nicht so viel Spielraum verbrauchen wie Low-End-Frequenzen. Es macht also Sinn, dass wir mehr wahrgenommene Lautstärke erreichen können, ohne unsere Pegel so schnell zu maximieren, indem wir den mittleren Bereich verstärken.

Eine gute Balance im mittleren Bereich ist für einen großartigen Mix unerlässlich, also achten Sie darauf, jeden Track angemessen zu mischen. Denken Sie daran, dass eine zu starke Verstärkung einer Frequenz zu Problemen führt, aber wenn Sie dem mittleren Bereich ein wenig zusätzlichen Pegel geben, kann dies dazu beitragen, dass der Mix lauter klingt.

Loudness Tipp 4: Chirurgischer EQ

Es kann sein, dass die Spuren innerhalb des Mixes eine oder mehrere Resonanzfrequenzen haben, die überrepräsentiert sind. Diese Frequenzen neigen dazu, im Mix hervorzustechen und die Zuhörer abzulenken.

Einzelne Tracks mit schlechten Resonanzen werden schrecklich klingen, bevor sie auf das Niveau gebracht werden, auf dem sie in der Mixbalance sein sollten.

Darüber hinaus nehmen Resonanzen auch den Spielraum auf, insbesondere wenn mehrere Spuren im selben Raum mit den gleichen akustischen Herausforderungen aufgenommen wurden. Wenn mehrere Spuren die gleichen Resonanzfrequenzen haben, summieren sich diese Frequenzen schnell im Mix.

Was allgemein als „chirurgischer EQ“ bezeichnet wird, ist eine effektive Methode, um diese Resonanzen zu reduzieren. Es ist effektiv ein parametrischer EQ, der auf die Problemfrequenz zentriert ist, mit einem engen Q und einer signifikanten Reduzierung des Pegels.

Der chirurgische EQ hilft, den Klang der Tracks und des Mixes als Ganzes zu verbessern und gleichzeitig die Lautstärke zu erhöhen.

Erstens wird das Entfernen dieser Problemfrequenzen aus einer einzelnen Spur dazu führen, dass sie besser klingt, wenn sie in der Balance nach oben gedrückt wird. Zweitens, wenn der Mix als Ganzes schlechte Aufbauten hat, kann die Reduzierung der Problemfrequenzen von nur ein paar Tracks mit chirurgischem EQ dazu beitragen, dass der Mix ein bisschen laut gedrückt wird (zusammen mit dem viel besseren Klang).

Ein Wort der Vorsicht: Es ist üblich, dass Leute vorschlagen, ein schmales Band auf dem EQ zu verstärken und es über das Frequenzspektrum zu fegen, um nach Problemfrequenzen zu suchen. Dies ist jedoch in der Praxis kontraproduktiv, da dadurch jede Frequenz problematisch klingt.

Bevor Sie nach problematischen Frequenzen suchen, hören Sie zuerst zu. Wenn es nichts Anstößiges gibt, suchen Sie nicht, um beleidigt zu sein. Es ist am besten, es in Ruhe zu lassen.

Wenn Sie jedoch hören, dass etwas nicht stimmt, kann ein sanfter Schub Ihnen helfen, das Problem zu finden.

Vielleicht ist es eine bessere Methode, zu erraten, wo das Problem liegt, das zu schneiden, was Sie für angemessen halten, und dann den EQ A / Bing zu machen, um zu hören, ob es eine Verbesserung hin oder her. Wenn nicht, versuchen Sie es erneut mit einer anderen Frequenz. Wiederholen Sie diesen Vorgang, bis der EQ das Problem gelöst hat.

Loudness Tipp 5: Verzerrung & Sättigung

Wenn wir etwas über Audio und Mixing lernen, werden Verzerrungen oft als der Feind dargestellt, den es um jeden Preis zu vermeiden gilt. Während unnötige Verzerrungen in unseren Geräten oft am besten vermieden werden sollten, ist Verzerrung (und insbesondere Sättigung) ein wichtiges Werkzeug bei der Musikproduktion und beim Mixen, das nicht ignoriert werden sollte.

Die technische Definition von Verzerrung ist jede Abweichung in der Form einer Audiowellenform zwischen zwei Punkten in einem Signalpfad. In dieser Hinsicht verzerren EQ und Kompression die Signale, die sie verarbeiten.

Verzerrung und Sättigung sind als Prozesse darauf ausgelegt, die Wellenform eines Signals zu formen, um einen gewünschten Effekt zu erzeugen.

Dieser Effekt kann ganz offensichtlich auf die Spitze getrieben werden, wie es bei verzerrten Gitarrenverstärkern oder Audiogeräten der Fall ist, die weit über ihre Signalverarbeitungsfähigkeiten hinausgehen.

Verzerrung und insbesondere Sättigung haben jedoch den Effekt einer weichen Kniekompression und harmonischen Sättigung.

Weiches Knie [dynamic range] Die Komprimierung hat einen „abgerundeten“ Schwellenwert. Der Umfang der Kompression, der auf das Signal angewendet wird, geschieht allmählich, wenn das Eingangssignal im Pegel ansteigt, bis das maximale Verhältnis erreicht ist.

Dies unterscheidet sich von der „Hard-Knee“-Kompression, bei der der Kompressor einrastet, wenn das Signal den eingestellten Schwellenwert überschreitet, und sich löst, wenn das Signal wieder unter den eingestellten Schwellenwert fällt.

Harmonische Sättigung ist die Erzeugung und Verstärkung von harmonischen Inhalten in einem Signal durch subtile Wellenformverzerrung.

Wie bereits erwähnt, sind die Obertöne einer Schallquelle ganzzahlige Vielfache des Grundmaterials, die weitgehend die Klangfarbe des Klangs ausmachen. Oberschwingungserzeugungen durch Sättigung führen jedoch effektiv Oberschwingungen auf dem Frequenzinhalt ein, der bereits im Audiosignal enthalten ist (einschließlich Grund, Oberschwingungen und sogar Rauschen).

Beide Effekte (Soft-Knee-Kompression und harmonische Erzeugung/Sättigung) treten auf, wenn die Spitzen der Audiowellenform durch Sättigung oder subtile Verzerrung sanft abgeflacht werden.

Wie kann dies dazu beitragen, die Lautstärke unseres Mixes zu erhöhen? Konzentrieren wir uns auf die Sättigung, obwohl auch subtile Verzerrungen verwendet werden können.

In Tipp 3 haben wir besprochen, wie subtile Erhöhungen im mittleren Bereich einen größeren Einfluss auf die Lautstärke haben als Steigerungen im unteren Bereich, ohne so viel Headroom zu verbrauchen.

Nun, EQ-Boosts im mittleren Bereich können die Aufgabe erfüllen, können aber nur den bereits im Audio vorhandenen Frequenzinhalt beeinflussen. Aus diesem Grund können EQ-Boosts oft etwas unnatürlich klingen oder, noch schlimmer, spürbare Geräuschpegel verursachen, ohne notwendigerweise den Klang zu erhöhen.

Die Sättigung erzeugt tatsächlich neue Frequenzen im Audiosignal. Die zusätzlichen Obertöne werden größtenteils im mittleren Bereich erzeugt, wodurch die wahrgenommene Präsenz und Lautstärke eines Tracks (oder des Mixes als Ganzes) erhöht wird, ohne einen großen Einfluss auf die Gesamtpegel zu haben.

Zum Beispiel kann die Sättigung einer Bassgitarre ihr mehr Präsenz in einem Mix verleihen, als das Low-End zu verstärken und gleichzeitig weniger Headroom zu verbrauchen.

Darüber hinaus kann der subtile Kompressionsaspekt der Sättigung dazu beitragen, die Spitzen eines Audiosignals zu zähmen, ohne die Dynamik vollständig zu unterdrücken, was einen kleineren Scheitelfaktor (die Differenz zwischen den Spitzen- und Durchschnittspegeln) und mehr Lautstärke vor dem Clipping ermöglicht.

Loudness-Tipp 6: Serielle Komprimierung

Wie der Name schon sagt, führt die serielle Komprimierung ein Signal durch mehrere Kompressoren in Reihe (nacheinander).

Mit moderner digitaler Signalverarbeitung und digitalen Audio-Workstations ist es einfach, mehrere Kompressoren auf einer bestimmten Spur einzusetzen. Die serielle Komprimierung erfolgt jedoch auch über Busse und Sends hinweg. Zum Beispiel kann eine einzelne Spur komprimiert, an einen Bus mit einem zweiten Kompressor gesendet und schließlich an den Mischbus gesendet werden, der auch einen Kompressor haben kann. In diesem Beispiel werden 3 Kompressoren parallel geschaltet, damit das Audio der jeweiligen Spur durchgeleitet werden kann.

Wenn es richtig gemacht wird, können wir die serielle Komprimierung verwenden, um den Scheitelfaktor zu reduzieren und die wahrgenommene Lautstärke von Elementen innerhalb eines Mixes zu erhöhen, ohne die typischen unerwünschten Artefakte hoher Komprimierungsstufen.

Zum Beispiel können wir oft mit 3 dB Verstärkungsreduzierung ohne merkliche Verzerrung und Pumpen auskommen. Diese negativen Nebenwirkungen wären bei 9 dB Verstärkungsreduktion viel auffälliger. Wenn wir jedoch 3 Kompressoren hintereinander hätten, die jeweils etwa 3 dB Verstärkungsreduzierung anwenden, könnten wir die 9 dB mit weniger auffälligen Nebenwirkungen erreichen.

Mit einer natürlicheren Verstärkungsreduzierung auf den Spitzen verengen wir den Kammfaktor und können daher Drücken Sie ein Element, einen Bus oder einen Mix als Ganzes lauter.

Ich sollte eine besondere Anmerkung zur Mix-Bus-Kompression erwähnen. Die Verwendung eines Mix-Bus-Kompressors bedeutet, dass jedes Signal, das vor dem Mix-Bus beeinflusst wird, Teil einer Signalkette mit paralleler Kompression ist.

Wie der Name schon sagt, funktioniert die Mix-Buskomprimierung auf dem gesamten Mix. Es ist eine gängige Technik, um Transienten zu zähmen, die Mischung zusammenzukleben und etwas mehr wahrgenommene Lautstärke zu gewährleisten.

Bei der Mix-Bus-Kompression muss sehr darauf geachtet werden, dass das Mix als Ganzes nicht überverarbeitet wird. Es ist ratsam, das Verhältnis niedrig zu halten (maximal 1,5:1 bis 4:1) und den Schwellenwert so einzustellen, dass die Verstärkungsreduzierung auf maximal etwa 3 dB gehalten wird.

Da sich diese Verarbeitung auf den gesamten Mix auswirkt, müssen wir darauf achten, Pumpen, Verzerrungen und andere Artefakte zu vermeiden, die einen Mix ruinieren würden, der sonst großartig klingen würde. Passen Sie die Angriffs- und Auslösezeiten an, damit der Kompressor besser mit dem Rhythmus und dem Gefühl der Musik arbeitet und den berüchtigten Pumpeffekt vermeidet.

Die Kompression des Mix-Busses zähmt Transienten auf Kosten der transienten Definition, daher sollten wir uns anhören, wie sich der Kompressor auf die Gesamtdruckigkeit der Drums und der Perkussion des Mixes auswirkt.

Achten Sie auf eine Zunahme der wahrgenommenen Lautstärke in den Seiten (links und rechts geschwenkte Elemente) sowie auf den relativen Anstieg des Pegels in den leiseren Teilen. Stellen Sie den Mix-Bus-Kompressor nach Bedarf ein, um die gewünschten Ergebnisse zu erzielen.

Wie immer, A / B den Prozess durch Anpassung der wahrgenommenen Pegel und Umgehung / Einschaltung des Kompressors.

Loudness Tipp 7: Parallele Kompression

Parallele Kompression ist die parallele Verarbeitung eines Audiosignals mit einer unkomprimierten (oder leicht komprimierten) „trockenen“ Version und einer stark komprimierten „nassen“ Version.

Die parallele Aufteilung des Signals wird meistens durch ein Senden / Zurückgeben erreicht, bei dem eine oder mehrere Spuren zur starken Kompression an einen Hilfsbus gesendet werden können, bevor sie mit den ursprünglichen Spuren am Mix-Bus zurücksummiert werden. Alternativ können wir einen Track duplizieren und die Kopie verarbeiten. Wenn unser Kompressor unserer Wahl über eine Nass-/Trockenregelung verfügt, funktioniert dies effektiv auch als Parallelverarbeitung.

Wir erreichen effektiv eine Aufwärtskompression, indem wir eine separate Version eines Audiosignals (oder eine Sammlung von Audiosignalen) stark komprimieren und bei niedrigeren Pegeln mischen.

Die Aufwärtskompression verringert den Dynamikbereich, indem die Signalpegel unter den Schwellenwert angehoben werden, anstatt die Signalpegel über den Schwellenwert zu senken (wie dies bei der typischen Komprimierung der Fall ist).

Wir müssen die Spitzenwerte mit paralleler Komprimierung im Auge behalten, da sie mit dem Mischen der komprimierten Version zunehmen können. Es hat jedoch immer noch den Effekt, den Durchschnittspegel stärker als die Spitzen zu erhöhen, wodurch der Scheitelfaktor verringert und eine große potenzielle Lautstärke ermöglicht wird.

Beachten Sie, dass das parallele Senden stark komprimiert werden sollte und an sich nicht gut klingt. Wenn wir es jedoch mischen, verleiht es den Spuren, die wir an den parallelen Kompressor senden, Gewicht und Lautstärke.

Achten Sie auf mögliche Phasenprobleme zwischen dem komprimierten Hilfsbus und den Originalspuren. Latenz und Signalverzögerung können unerwünschte Phasenprobleme verursachen (im Allgemeinen als Kammfilterung und Mangel an Low-End zu hören), die dem Mix mehr schaden als nützen können.

Andere Nebenwirkungen sind etwas weniger Punch auf Transienten (wenn auch nicht so viel wie „normale“ Mix-Bus-Kompression), weniger Kontrolle über die Spitzenpegel (was zu Clipping führen kann, wenn wir nicht vorsichtig sind) und größere relative Pegelzunahmen in spärlicheren Abschnitten des Songs.

Ich habe ein Video, das detaillierter auf die parallele Verarbeitung eingeht, dass Sie Schauen Sie sich hier an:

Loudness Tipp 8: Multiband-Kompression

Multiband-Komprimierung ist ein Dynamikprozessor, der ein Signal in verschiedene Frequenzbänder (oft 3 oder 4) aufteilt und unabhängige Komprimierungssteuerungen für jedes Band hat.

Die Fähigkeit, jedes Band anders zu komprimieren, ermöglicht es uns, mehr oder weniger Kompression zu erhalten, wie es notwendig ist. Wir können auch vermeiden, über das gesamte Signal zu pumpen, wenn ein Band mehr Energie hat als die anderen. Die Multiband-Kompression hilft, das Pumpen und die Verstärkungsreduzierung bestimmter Bänder zu vermeiden, wenn der Gesamtsignalpegel den Schwellenwert überschreitet.

So kann Multiband-Komprimierung, wie normale Komprimierung, dazu beitragen, die Lautstärke zu erhöhen, indem der Scheitelfaktor reduziert wird. Nur mit Multiband-Kompression haben wir viel mehr Kontrolle über die einzelnen Frequenzbänder.

Achten Sie auf die möglichen Änderungen der Frequenzbalance, da verschiedene Bänder unterschiedliche Verstärkungsreduzierungen erfahren. Wenn jedes Band eine unterschiedliche Verstärkungsreduzierung aufweist, wird das Band mit dem geringsten BetragErzielen Sie einen Level-Boost, während das Band mit der größten Verstärkungsreduzierung einen „Cut“ erhält.

Während die Multiband-Komprimierung auf dem Mix-Bus uns also große Leistung verleiht, gibt sie uns auch die Verantwortung, sicherzustellen, dass sie das Gleichgewicht des gesamten Mixes nicht aus dem Gleichgewicht bringt. Glücklicherweise sind wir bei der Anwendung der Mix-Bus-Kompression oft nur nach ein paar dB Verstärkungsreduzierung, was zu unseren Gunsten wirkt. Wir müssen jedoch wachsam sein, um sicherzustellen, dass das Gleichgewicht gewahrt bleibt.

Die Multiband-Kompression knüpft für einen Moment an Tip 4 an und ist ein gängiger Prozessor zur De-essierung und Reduzierung anderer dynamischer Resonanzfrequenzen, die periodisch heraustreten. Wenn es Problemfrequenzen in einer Spur gibt, die nicht immer vorhanden sind (z. B. Zischlaute im Gesang), können wir ein Band mit einem Multiband-Kompressor um die Problemfrequenzen verengen und sie nur komprimieren, wenn sie vorhanden sind.

Dieser Multiband-Kompressor „De-Essing“ wiederum ermöglicht es uns, die Pegel der problematischen Spur zu erhöhen, ohne dass die Resonanz(en) damit gesteigert werden.

Wir werden die Begrenzung in Tipp 11 ausführlicher besprechen, aber die Multibandbegrenzung kann auch dazu beitragen, die Lautstärke zu erhöhen.

Darüber hinaus kann der dynamische EQ so eingestellt werden, dass er sich ähnlich wie die Multiband-Kompression verhält und daher auch zur Erhöhung der Lautstärke verwendet werden kann.

Loudness Tipp 9: Automatisierung

Automatisierung ist im Grunde die Änderung von Parametern im Laufe der Zeit während des Mischens.

Durch die Automatisierung der relativen Pegel einzelner Gleise und Busse können wir die Lautstärke über verschiedene Abschnitte von Anordnungen hinweg aufrechterhalten.

Umgekehrt kann die Automatisierung der Gleispegel dazu beitragen, den langfristigen Dynamikbereich eines Mixes zu erweitern, wodurch wir Abschnitte erhalten, die relativ laut und andere relativ leise sind.

Wie bereits erwähnt, ist „Lautstärke“ weitgehend relativ (sei es zu anderen Liedern oder zwischen Abschnitten oder sogar Instrumenten innerhalb eines Songs). Daher wird eine gute Langzeitdynamik die klimatischeren Teile des Songs lauter klingen lassen. Dies kann allein durch Absprache erreicht werden (siehe Tipp 1), aber auch durch Automatisierung.

Neben der Automatisierung von Fadern können wir EQ-Einstellungen, Kompressoreinstellungen, Sättigungseinstellungen und mehr automatisieren, um sicherzustellen, dass jeder Abschnitt des Songs seine richtige Balance und Lautstärke hat.

Ich habe ein Video, in dem meine Top 11 Automatisierungstipps zum Mischen besprochen werden. Schaut es euch hier an:

Loudness Tipp 10: Hall

Dieser Tipp wird normalerweise nicht ausgedrückt, wenn man etwas über Lautstärke beim Mischen lernt. Eine geschmackvolle Menge an Hall auf einzelnen Gleisen und Bussen kann jedoch die wahrgenommene Lautstärke eines Mixes verbessern, indem sie ein musikalisches Ambiente hinzufügt, insbesondere zwischen Transienten.

Wenn Sie Reverb verwenden, empfehle ich immer, einen Send / Return für den Halleffekt einzurichten, um die größtmögliche Kontrolle zu haben. Wir können auch mehrere Spuren an einen einzigen Hall-Send senden, um die Dinge zusammenzukleben und gleichzeitig die CPU-Last (in DAWs) zu reduzieren.

Es ist oft vorteilhaft, das Low-End vom Hall-Send zu filtern, um unnötigen Aufbau und Phase in den Bassfrequenzen zu vermeiden. Die Anpassung des Halls an den Geschmack kann einige Zeit in Anspruch nehmen, und ich schlage vor, darauf zu hören, wie der Hall zum Timing der Mischung passt und wie er die Seiten der Mischung beeinflusst.

Das Hinzufügen eines Raumgefühls mit mehreren Hallen kann verschiedenen Elementen innerhalb des Mixes Dimension verleihen und ihn letztendlich lauter klingen lassen.

Beachten Sie, dass in dichteren Mischungen die Verzögerung möglicherweise eine bessere Option als der Hall ist, um die gleichen Effekte wie oben beschrieben zu erzielen.

Loudness Tipp 11: Verwenden Sie Limiter

Wenn es darum geht, die Lautstärke beim Mastering zu erhöhen, ist der Limiter vielleicht das häufigste Werkzeug. Es ist auch nützlich beim Mixen, obwohl wir darauf achten sollten, unsere Rolle zu verstehen und den Mix vor dem Mastering nicht zu begrenzen (es sei denn, wir sind auch der Mastering-Ingenieur).

Die Begrenzung ist effektiv die Komprimierung mit einem Verhältnis von ∞:1. Mit anderen Worten, Limiter begrenzen den maximalen Signalpegel auf einen festgelegten Schwellenwert.

Beachten Sie, dass es wie bei Kompressoren Zeitfaktoren in Begrenzern gibt. Limiter sind mit Angriffen und Release-Zeiten ausgelegt. Sie wirken, indem sie das Signal als Ganzes dämpfen, wenn der momentane Signalpegel versucht, den Schwellenwert zu überschreiten (dies geschieht über ein Zeitfenster und nicht augenblicklich innerhalb der Wellenform selbst).

Durch die Dämpfung der Spitzen, so dass sie einen festgelegten Schwellenwert nicht überschreiten, kann die Begrenzung einen massiven Effekt auf die Verringerung des Scheitelfaktors haben und zusätzliche Lautstärke in den Tracks und im Mix als Ganzes erzielen.

Ich neige dazu, eine maximale Reduzierung von -3 dB auf dem Master-Limiter zu halten, um das Pumpen zu vermeiden, und verwende bei Bedarf eine serielle Begrenzung (wie serielle Kompression), wenn eine stärkere Verstärkungsreduzierung erforderlich ist.

Wenn Sie mit dem Mast beauftragt sindWenn Sie Ihren Mix für die Überwachung auf verschiedenen Wiedergabesystemen oder zumindest „pseudo-mastering“ machen, schränken Sie wahrscheinlich den Master-Bus (oder Mix-Bus) ein.

Hier ist eines meiner Videos, in dem erklärt wird, wie man die Begrenzung verwendet, um „wettbewerbsfähige“ Ebenen in einer Mischung für die Überwachung und Referenzierung zu erhalten vor Bewältigung:

Loudness Tipp 12: Experimentieren Sie vorsichtig mit Clipping

Es ist im Allgemeinen am besten, beim Lernen Clipping zu vermeiden. Digitale Verzerrungen klingen in den meisten Fällen schrecklich. Regeln sollen jedoch gebrochen werden, und geschmackvolles Clipping kann durchaus die wahrgenommene Lautstärke erhöhen. Es geht also darum, den Ausschnitt gut klingen zu lassen.

Einige Produzenten/Mischer gehen sogar so weit, die einzelnen Audiodateien so zu formen, dass ein längeres Clipping und vorübergehendes Shaping erreicht wird.

Im Gegensatz zum Limitieren erfolgt das Clipping sofort und schneidet die Oberseite der Audiowellenform am Clipping-Punkt ab (0 dBFS sind digitale Systeme). Es gibt keinen Versuch der Dämpfung mit Clipping. Die Wellenform ist perfekt linear bis zum Clipping-Punkt, an dem die Wellenform vollständig abgeschnitten wird, bis sie wieder unter den Clipping-Punkt fällt.

Dies erhöht die Lautstärke auf Kosten der Verzerrung. Das Schneiden/Abflachen einer Wellenform formt die Wellenform in Richtung einer Rechteckwelle, die die grundlegende Wellenform mit dem größten Effektivwert ist (im Vergleich zu Sinus, Dreieck und Sägezahn).

Rechteckwellen haben unendliche Oberschwingungen ungerader Ordnung, so dass wir erwarten können, dass eine signifikante harmonische Erzeugung ungerader Ordnung stattfindet, wenn wir unsere Signale digital abschneiden.

Aber der hässliche Teil des digitalen Clippings kommt vom Aliasing, das zu unharmonischen Verzerrungen führt, wenn Artefakte bei Frequenzen unterhalb des Quellfrequenzgehalts erzeugt werden. Wie die Sättigung gilt dies nicht nur für den grundlegenden, sondern auch für den ursprünglichen harmonischen Inhalt und sogar für das Rauschen, was zu unmusikalischen, lauten, unharmonischen Verzerrungen führt.

Eine kurze Diskussion über den Loudness War

Der anhaltende Lautheitskrieg ist der Trend, Schallplatten lauter zu machen als andere. Dieser „Krieg“ dauert seit Jahrzehnten an, wo es eine Art Wettbewerb gibt, um Schallplatten so laut wie möglich zu machen.

Die Grundidee hinter dem Loudness War ist es, die Loudness Bias zu nutzen, bei der die Menschen natürlich dazu neigen, lautere Musik zu bevorzugen. Wenn ein lauterer Song nach einem ruhigeren Song gespielt wird, klingt er möglicherweise besser oder professioneller.

Was der Loudness-Krieg nicht berücksichtigt, ist, dass die Zuhörer letztendlich die Kontrolle über die Lautstärke haben, so dass sie ihre Musik auf- und runterdrehen können, je nachdem, ob sie zu leise bzw. zu laut ist.

Es gibt viele Kontroversen um den Loudness-Krieg, wobei viele Ingenieure und Zuhörer die Praxis anprangern und viele Branchenchefs, Künstler und Zuhörer die Praxis aufrechterhalten.

Die Lautstärke wird mit vielen der oben genannten Techniken erreicht, zusammen mit dem Mastering, das sich darauf konzentriert, die größtmögliche Lautstärke zu erzielen.

Wie bereits in diesem Artikel erwähnt, hat Lautstärke ihren Preis. Viele Platten, die zu „Opfern des Lautheitskrieges“ geworden sind, klingen unglaublich ermüdend, verzerrt und subjektiv unerfreulich auf Kosten der Lauterkeit als die Konkurrenz.

Heute normalisieren viele Streaming-Dienste Audio standardmäßig, um die Lautstärkeunterschiede zwischen den Songs so gering wie möglich zu halten. Dies bedeutet, dass ein super „lauter“ Song automatisch auf einen festgelegten Pegel heruntergedreht wird, während ein „leiser“ Song automatisch auf den gleichen eingestellten Pegel gebracht wird.

Bei dieser Normalisierungspraxis schadet Lautstärke um der Lautstärke willen tatsächlich der Qualität des Songs. Superlautes Audio hat jetzt nur noch die negativen Aspekte (ermüdender Mangel an Dynamikumfang, Verzerrung, schlechte Definition usw.), ohne das Gefühl zu haben, lauter zu sein.

Meiner Meinung nach ist der Lautheitskrieg. Es ist jedoch wichtig zu verstehen, wie man konkurriert. Schließlich ist es besser, ein Krieger in einem Garten zu sein als ein Gärtner in einem Krieg.

Verwandte Fragen

Mit welcher Lautstärke sollte Audio gehört und gemischt werden? Kritisches Hören sollte auf verschiedenen Pegeln erfolgen, obwohl 80 – 85 dB SPL der Sweet Spot mit der besten Frequenzbalance und dem geringen Risiko von Hörschäden ist. Niedrige Werte helfen uns, Elemente zu identifizieren, die zu niedrig in der Mischung sind, während hohe Werte uns die Mischung hören / fühlen lassen, wobei ein höheres Risiko für Gehörschäden besteht.

Die Auswahl der besten Audio-Plugins für deine DAW kann eine herausfordernde Aufgabe sein. Aus diesem Grund habe ich den Comprehensive Audio Plugins Buyer’s Guide von My New Microphone erstellt. Schauen Sie es sich an, um Hilfe bei der Bestimmung Ihrer nächsten Audio-Plugin-Käufe zu erhalten.