Audio: Was sind die Unterschiede zwischen Polarität und Phase?

Die Begriffe „Phase“ und „Polarität“ werden im Audio oft synonym verwendet, obwohl sie technisch unterschiedliche Dinge bedeuten. Wenn Sie sich jemals über den Unterschied zwischen Phase und Polarität gewundert haben, sind Sie an der richtigen Stelle, um es herauszufinden.

Was sind die Unterschiede zwischen Polarität und Phase im Audio? Die Polarität bezieht sich auf die Position eines Audiosignals über oder unter dem Referenzwert/der Referenzspannung. Wenn Sie die Polarität eines Signals umkehren, werden positive und negative Spannungen vertauscht. Phase referenziert einen Punkt entlang der Wellenform eines Audiosignals. Bei sich wiederholenden Wellenformen hat jeder komplette Zyklus eine Phase von 360º.

In diesem Artikel werden wir Polarität und Phase klarer definieren, um die Unterschiede zwischen den beiden Begriffen besser zu verstehen.

Was ist Polarität?

Polarität ist vielleicht der einfachere der beiden Begriffe zu verstehen, also fangen wir damit an. Jedes elektrische Signal oder jede Wellenform (einschließlich analoger Audiosignale und ihrer digitalen Darstellungen) hat Polarität.

Die Polarität eines Audiosignals bezieht sich auf seine Position über (positiv) oder unter (negativ) dem Referenzwert/der Spannung. Diese Referenzlinie oder Medianlinie liegt unabhängig vom Median-/Referenzsignalwert bei „Nullamplitude“ (dies berücksichtigt die Vorspannung und andere Offsets).

Die Polarität eines Signals ist also im Wesentlichen eine Funktion seiner positiven und negativen Punkte entlang seiner Wellenform.

An sich ist Polarität für uns im Audiobereich nicht so interessant.

Wenn wir jedoch mehrere Signale haben, ist die Polarität eine Überlegung wert. Dies gilt insbesondere, wenn die Signale Kopien voneinander sind.

Wenn wir zwei identische Signale hätten, könnten wir sie addieren, um den doppelten Signalpegel zu erreichen. Dies kann im Folgenden visualisiert werden:

Wenn wir nun die Polarität des zweiten (blauen) Signals umkehren würden, würden sich die beiden identischen Signale vollständig aufheben. Die Punkte der positiven Amplitude in einem Signal würden die negativen Amplituden des anderen destruktiv stören und umgekehrt. Das Ergebnis würde so aussehen:

Der Vorteil der Polarität, insbesondere bei identischen Signalen, besteht darin, dass wir die Phase nicht verschieben, indem wir Signale verzögern. Vielmehr drehen oder kehren wir einfach die Polarität um, so dass alle positiven Werte negativ und alle negativen Werte positiv werden.

Polarität ist in der Audiotechnik sicherlich wichtig. Betrachten wir einige Fälle, in denen die Polarität berücksichtigt werden sollte:

- Polarität und Lautsprecheranschlüsse

- Polarität und symmetrischer Klang

- Polarität und Aufnahme/Mischung

Polaritäts- und Lautsprecheranschlüsse

Lautsprecher haben typischerweise positive und negative Eingangsanschlüsse. Das positive Lautsprecherkabel verbindet den positiven Ausgangsanschluss des Verstärkers mit dem positiven Eingangsanschluss des Lautsprechers. Das negative Lautsprecherkabel hingegen verbindet den negativen Ausgangsanschluss des Verstärkers mit dem negativen Eingangsanschluss des Lautsprechers.

Der Austausch dieser beiden Drähte würde theoretisch dazu führen, dass der Lautsprecher Luft zieht, wenn er Luft drücken soll und umgekehrt.

Wenn es nur einen Lautsprecher in einem System gibt, ist der Effekt des Vermischens der Lautsprecherkabel minimal und nicht wahrnehmbar.

Die Probleme treten auf, wenn mehrere Lautsprecher verwendet werden, z. B. in einer Stereoanlage, und sich ein oder mehrere Lautsprecher in umgekehrter Polarität zu den anderen Lautsprechern befinden. Dies führt zu erheblichen Problemen mit destruktiven Störungen in der akustischen Umgebung.

Wenn wir ein Paar Lautsprecher betrachten, die in umgekehrter Polarität verdrahtet sind, werden wir glanzlose Ergebnisse haben, obwohl wir wahrscheinlich keine absolute Stornierung haben werden.

Erstens, wenn das Audio, das den Lautsprechern zugeführt wird, in Stereo ist, hat jeder Lautsprecher zunächst ein anderes Audiosignal, obwohl jede Gemeinsamkeit (mittig geschwenkte Elemente) darunter leidet. Zweitens ermöglichen die Abstände zwischen den Lautsprechern und dem/den Zuhörer(n) innerhalb der akustischen Umgebung, dass ein gewisser Klang gehört wird, selbst wenn die Lautsprecher in umgekehrter Polarität zueinander verdrahtet sind.

Davon abgesehen ist es immer am besten, solche Verkabelungsprobleme zu vermeiden.

Polarität und ausgewogenes Audio

Balanced Audio ist ein System, das ein analoges Monosignal mit drei leitenden Drähten (Audio mit positiver Polarität, Audio mit negativer Polarität und Common Ground) überträgt.

Diese Art der Audioübertragung ist sowohl bei Mikrofonpegelgeräten (Mikrofone und Mikrofoneingänge) als auch bei Geräten mit niedrigem Pegelpegel (Keyboards usw.) üblich und trägt dazu bei, die Signalverschlechterung über lange Kabelwege zu minimieren.

Die beiden Signaldrähte in symmetrischem Audio heben sich gegenseitig auf, da sie Signale übertragen, die in entgegengesetzter Polarität zueinander sind. Ein symmetrischer Eingang erfordert daher Differenzverstärker. Diese UnterschiedeL-Ampere summieren effektiv die Unterschiede zwischen den beiden Signaldrähten und eliminieren gleichzeitig das induzierte Rauschen, das jedem Signaldraht gemeinsam wäre. Dieser Vorgang wird als Gleichtaktunterdrückung bezeichnet.

Polarität und Aufnahme/Mischung

Beim Aufnehmen und Mischen von Audio sollten wir uns der Polarität und Phase bewusst sein, obwohl wir uns in diesem Abschnitt mit der Polarität befassen.

Sie werden wahrscheinlich Polaritätsumkehr- oder „Phase Flip“ -Schalter an Vorverstärkern, Konsolen, digitalen Audio-Workstations und anderen Audiogeräten finden. Der Ausdruck „Phasenflip“ ist eigentlich eine falsche Bezeichnung, da die tatsächliche Wirkung dieser Optionen mit der Umkehrung der Polarität zu tun hat (vielleicht kommt hier ein Teil der Verwirrung her).

Polaritätsinversionen können bei Aufnahme- und Mischsitzungen unerlässlich sein, um die verschiedenen Spuren der Sitzung besser aufeinander abzustimmen. Wir wissen, wie schlecht ausgerichtete Signale destruktiv interferieren, wenn sie summiert / gemischt werden, daher ist es in unserem besten Interesse, die besten Beziehungen zwischen den positiven und negativen Amplituden unserer Signale zu haben.

Wenn zwei Mikrofone so positioniert sind, dass sie sich gegenüberstehen (ein häufiges Ereignis beim Mikrofonieren der Ober- und Unterseite einer Snaredrum), ist die Wahrscheinlichkeit hoch, dass ein Signal positiv ist, während das andere im Negativ ist (und umgekehrt). Dies ist auch der Fall, wenn zwei Mikrofone, die dieselbe Quelle in unterschiedlichen Entfernungen erfassen, nicht richtig positioniert sind, um die Verzögerung der Schallwellen zu berücksichtigen.

Weitere Informationen zur Mikrofonpositionierung finden Sie in meinem Artikel Top 23 Tipps für eine bessere Mikrofonplatzierung.

Möglicherweise möchten wir auch die Polarität von Samples umkehren, um sie besser mit den anderen Audiospuren in der Session abzustimmen.

Beachten Sie, dass wir es in diesen Fällen nicht mit identischen Wellenformen zu tun haben. Das Umdrehen der Polarität eines Signals kann jedoch dazu beitragen, dass es sich besser an den anderen ausrichtet.

Was ist Phase?

Nun, da wir wissen, was Polarität ist, lassen Sie uns die Phase besprechen. Wir beginnen unsere Diskussion über die Phase, indem wir sie mit der Polarität vergleichen, bevor wir tiefer in die Phase selbst eintauchen und wie sie in Audio verwendet wird.

Phase bezieht sich auf die Position eines Zeitpunkts in einem Wellenzyklus, gemessen in Grad. In einer periodischen Wellenform wie einem sich wiederholenden Audiosignal (wie der Sinuswelle) beginnt der Anfang einer Wellenform bei 0º und wiederholt sich alle 360º.

Phase ist eine Funktion der Zeit, und höhere Frequenzen (mit kürzeren Wellenlängen) benötigen weniger Zeit, um ihren vollen 360º-Zyklus zu durchlaufen.

Dieser Zyklus und diese Phase können in der folgenden Grafik visualisiert werden:

Die Umkehrung der Polarität dieser Wellenform würde so aussehen:

Beachten Sie, dass in diesem sehr speziellen Fall die Umkehrung der Polarität dasselbe ist wie die Verschiebung der Phase um 180º (vorausgesetzt, die Sinuswelle wiederholt sich bei derselben Amplitude unendlich).

Das Ändern oder „Verschieben“ der Phase bedeutet jedoch, dass das Signal zeitlich bewegt wird, während dies bei der Polaritätsinversion nicht der Fall ist.

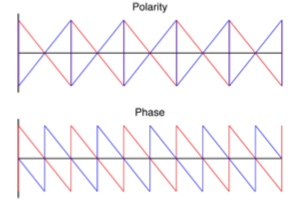

Wenn wir eine andere grundlegende Wellenform wie die Sägezahnwelle nehmen würden, hätten wir sehr unterschiedliche Ergebnisse zwischen der Umkehrung der Polarität und der Verschiebung der Phase um 180º.

Hier ist eine Überlagerung einer originalen Sägezahnwelle und einer invertierten Kopie:

Hier ist eine Überlagerung einer originalen Sägezahnwelle und einer um 180º verschobenen Kopie:

Die Dinge werden noch unähnlicher, wenn wir uns mit komplexen Audiowellenformen befassen (die die überwiegende Mehrheit des Audios ausmachen).

Tatsächlich ist Phase im wahrsten Sinne des Wortes im Zusammenhang mit sich wiederholenden Wellenformen nicht unbedingt das, was wir im Audio diskutieren, da wir es hauptsächlich mit hochkomplexen, sich nicht wiederholenden Wellenformen zu tun haben. Die Idee, dass Phase der zeitabhängige Ort einer Audiowellenform ist, ist jedoch eine wertvolle Idee, die in Audio zu verstehen ist und oft in der Welt der Audio- und Musikproduktion verwendet wird.

Polaritätsinversion und Phasenverschiebung sind also nicht dasselbe.

Betrachten wir nun, wie Phase in Audio verwendet wird:

Phase und Mischen

Während Polarity Flipping uns helfen kann, die verschiedenen Spuren in unseren Aufnahme- / Mischsitzungen auszurichten, sind wir begrenzt, wie sehr wir jede Spur wirklich ausrichten können. Wenn wir zur Phasenverschiebung übergehen, erreichen wir eine viel größere Kontrolle über das Timing jeder Spur, was uns ein klinischeres Werkzeug bietet, um unsere Spuren für bessere „Phasenbeziehungen“ auszurichten.

Ich habe auch ein Video, in dem die Bedeutung der richtigen Phasenbeziehungen beim Mischen diskutiert wird. Sie können das hier überprüfen:

Über die Phasenbeziehungen zwischen einzelnen Spuren hinaus sollten wir uns der Phasenbeziehungen zwischen unseren linken und rechten Stereokanälen bewusst sein. Es sind die Unterschiede zwischen dem linken und rechten Kanal, die uns effektiv das Gefühl geben, der Stereobreite. Zu weit gehend können diese Phasenunterschiede jedoch unseren Mix zerstören und jede Chance auf eine gute Monokompatibilität ruinieren.

Phasenkorrelationsmessgeräte reichen kontinuierlich von -1 bis +1 oder von 180º bis 0º. Sie können auf Stereospuren oder dem Stereo-Mix-Bus platziert werden, um die Phasenbeziehung zwischen den linken und rechten Stereowellenformen zu messen.

Bei +1 haben wir eine 100%ige Korrelation zwischen den Kanälen (sie sind genau gleich).

Bei 0 haben wir die „größte zulässige Links/Rechts-Divergenz“ oder das breiteste zulässige Stereobild.

Ideal ist es, wenn sich das Mix-Bus-Korrelationsmessgerät zwischen 0 und 1 bewegt. Kleinere Variationen bedeuten geringere Unterschiede in der Breite.

Bei -1 sind unser linker und rechter Kanal völlig phasenverschoben und heben sich gegenseitig vollständig auf.

Mix-Bus-Korrelationsmesswerte zwischen -1 und 0 bedeuten, dass signifikante Phasenprobleme vorliegen, die das Stereo-Audio und definitiv das summierte Mono-Audio beeinträchtigen.

Am besten bewegen Sie den Mauszeiger zwischen 0 und +1. Wir möchten jedoch, dass unsere Mischungen etwas näher an +1 liegen, um bessere Phasenbeziehungen zwischen dem linken und rechten Kanal und damit eine bessere Monokompatibilität zu gewährleisten.

Ich spreche über die Bedeutung des periodischen Mischens in Mono während der gesamten Mischung in Dieses Video.

Phasen- und Audioeffekte

Phase wird in mehreren Audioeffekten verwendet.

Der erste, der mir in den Sinn kommt, ist der Phaser, der eine Reihe von Allpassfiltern verwendet (die als Nebeneffekt eine Phasenverschiebung erzeugen), um verschiedene modulierte Kerben und Spitzen über das Frequenzspektrum zu erzeugen.

Apropos Filter, EQ hat einen inhärenten Nebeneffekt der frequenzabhängigen Phasenverschiebung bei und um die Ecke oder Mittenfrequenzen. Je größer/steiler die EQ-Bewegung/Filter, desto größer die Phasenverschiebung (positiv oder negativ). Obwohl dies nicht die primäre Verwendung für den Prozess ist, denke ich, dass es sich lohnen würde, nach der Diskussion des Phasers näher darauf einzugehen.

Wir haben auch einen linearen Phasen-EQ, der jede Phasenverschiebung im zu verarbeitenden Signal negiert.

Ich habe ein Video, in dem die Beziehung zwischen EQ und Phasenverschiebung diskutiert wird. Schaut es euch hier an:

Effekte wie Chorus, Flanger und Vibrato arbeiten alle mit einer modulierten Verzögerungsschaltung, die die Phase eines Signals effektiv moduliert, um den Effekt zu erzeugen (die Verzögerungszeit der Verzögerungsschaltung wird moduliert).